|

|

【SimpleLiteD3d.csのソース】

using System;

using System.IO;

using System.Collections.Generic;

using System.Diagnostics;

using System.Drawing;

using System.Threading;

using System.Windows.Forms;

using Microsoft.DirectX; // DirectXを使う為

using Microsoft.DirectX.Direct3D; // DirectXを使う為

using NyARToolkitCSUtils.Capture; // NyARToolkitのキャプチャー部

using NyARToolkitCSUtils.Direct3d; // NyARToolkitの3次元描画部

using NyARToolkitCSUtils.NyAR; // NyARToolkitのマーカー検出部

using jp.nyatla.nyartoolkit.cs; //

using jp.nyatla.nyartoolkit.cs.core; //

using jp.nyatla.nyartoolkit.cs.detector; //

using System.Runtime.InteropServices; // DllImport機能によりWin32APIを使う為

namespace SimpleLiteDirect3d

{

public partial class SimpleLiteD3d : IDisposable, CaptureListener

{

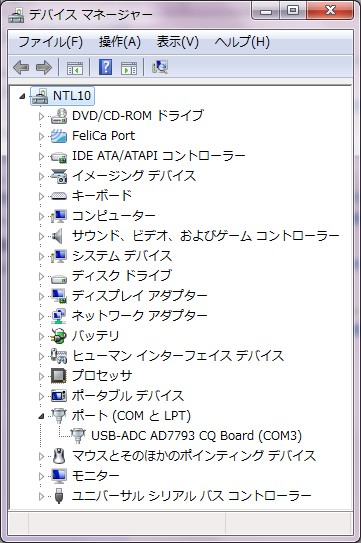

private const String COMPORT = "COM1"; //【A/Dコンバータ通信用ComPort番号】

private const int SCREEN_WIDTH=640; //【表示領域の横方向画素数】

private const int SCREEN_HEIGHT=480; //【表示領域の縦方向画素数】

private const String AR_CODE_FILE = "../../../Data/patt.hiro"; //【マーカー(Hiro)のパターンデータへのパス】

private const String AR_CAMERA_FILE = "../../../Data/camera_para.dat"; //【カメラ情報へのパス】

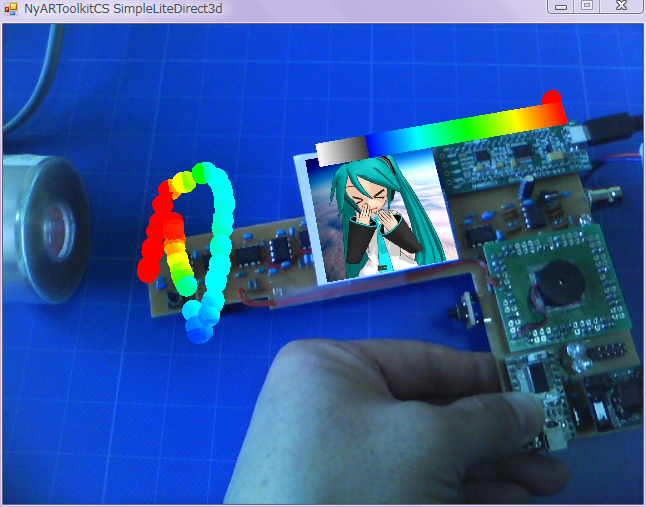

private const String TEXTURE_FILE = "../../../img/ColorBar.jpg"; //上下、左右逆

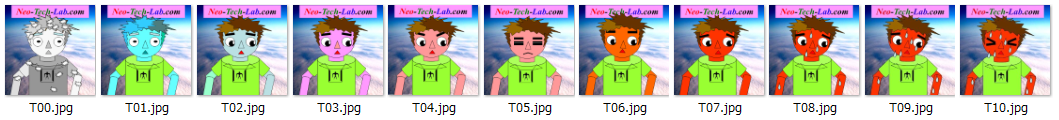

private const String MTEXTURE_FILE1 = "../../../img/Miku1.jpg"; //上下、左右逆

private const String MTEXTURE_FILE2 = "../../../img/Miku2.jpg"; //上下、左右逆

// private const String MTEXTURE_FILE1 = "../../../img/Robo1.jpg"; //上下、左右逆

// private const String MTEXTURE_FILE2 = "../../../img/Robo2.jpg"; //上下、左右逆

private CaptureDevice _cap; // DirectShowからのキャプチャー

private NyARSingleDetectMarker _ar; // NyARToolkit

private DsBGRX32Raster _raster; // NyARToolkit

private NyARD3dUtil _utils; // NyARToolkit

private NyARSurface_XRGB32 _surface; // 背景テクスチャー(カメラで取得したフレーム画像、NyARToolkitマーカー検出用画像データ)

private Device _device = null; // Direct3Dデバイス

private VertexBuffer _vertexBuffer = null; //【頂点バッファ】球体の頂点情報(座標と色)を格納するバッファ

private IndexBuffer _indexBuffer = null; //【インデックスバッファ】球体を構成する三角形の頂点番号を格納するバッファ

private VertexBuffer _vertexBufferT = null; //【頂点バッファ】球体の頂点情報(座標と色)を格納するバッファ

private IndexBuffer _indexBufferT = null; //【インデックスバッファ】球体を構成する三角形の頂点番号を格納するバッファ

private Texture _texture = null; //【テクスチャーバッファ】カラーゲージ格納用

private VertexBuffer _vertexBufferM = null; //【頂点バッファ】球体の頂点情報(座標と色)を格納するバッファ

private Texture _Mtexture1 = null; //【テクスチャーバッファ】ちびミク格納用1

private Texture _Mtexture2 = null; //【テクスチャーバッファ】ちびミク格納用2

public const int nVertex = 92; //【球体モデル】頂点数

public const int nTriangle = 180; //【球体モデル】ポリゴン数(三角形)

public const float Bairitsu = 20.0f; //【球体モデル】表示倍率

private static CustomVertex.PositionNormal[] vertices = new CustomVertex.PositionNormal[nVertex]; // 球体モデルの頂点情報を格納メモリを確保

private static CustomVertex.PositionTextured[] verticesT = new CustomVertex.PositionTextured[4]; // カラーバーの頂点情報を格納メモリを確保

private static CustomVertex.PositionTextured[] verticesM = new CustomVertex.PositionTextured[4]; // ちびミク表示枠の頂点情報を格納メモリを確保

//【球体モデル】頂点情報:92個の頂点からなる球体モデルのデータ【CustomVertex.PositionNormal形式用】

private static float[] _vertex = new float[] {

// ■MetasequoiaLE R2.4で球体モデルを作成⇒.x形式で保存⇒Excelで読込・編集

// x座標, y座標, z座標, 法線Nx, 法線Ny, 法線Nz

0.00000000f, 0.20000000f, 0.00000000f, 0.00000000f, 1.00000000f, 0.00000000f,

0.03633000f, 0.19021000f, -0.05000000f, 0.00000000f, 0.95128700f, -0.30830600f,

0.00000000f, 0.19021000f, -0.06180000f, 0.17470500f, 0.94062300f, -0.29104300f,

0.05878000f, 0.19021000f, -0.01910000f, 0.31241300f, 0.94062200f, -0.13276900f,

0.05878000f, 0.19021000f, 0.01910000f, 0.33078800f, 0.94062200f, 0.07622100f,

0.03633000f, 0.19021000f, 0.05000000f, 0.22281000f, 0.94062300f, 0.25609500f,

0.00000000f, 0.19021000f, 0.06180000f, 0.02972900f, 0.94062300f, 0.33814800f,

-0.03633000f, 0.19021000f, 0.05000000f, -0.17470500f, 0.94062300f, 0.29104300f,

-0.05878000f, 0.19021000f, 0.01910000f, -0.31241300f, 0.94062200f, 0.13276900f,

-0.05878000f, 0.19021000f, -0.01910000f, -0.33078800f, 0.94062200f, -0.07622100f,

-0.03633000f, 0.19021000f, -0.05000000f, -0.21049000f, 0.93368000f, -0.28971700f,

0.00000000f, -0.19021000f, -0.06180000f, -0.03291900f, 0.82232000f, -0.56807300f,

0.03633000f, -0.19021000f, -0.05000000f, 0.33405400f, 0.80964100f, -0.48258600f,

0.00000000f, -0.20000000f, 0.00000000f, 0.55391500f, 0.80964000f, -0.19406500f,

0.05878000f, -0.19021000f, -0.01910000f, 0.56219600f, 0.80964000f, 0.16857800f,

0.05878000f, -0.19021000f, 0.01910000f, 0.35573600f, 0.80964300f, 0.46683000f,

0.03633000f, -0.19021000f, 0.05000000f, 0.01340000f, 0.80964100f, 0.58677300f,

0.00000000f, -0.19021000f, 0.06180000f, -0.33405400f, 0.80964100f, 0.48258600f,

-0.03633000f, -0.19021000f, 0.05000000f, -0.55391500f, 0.80964000f, 0.19406500f,

-0.05878000f, -0.19021000f, 0.01910000f, -0.56219600f, 0.80964000f, -0.16857800f,

-0.05878000f, -0.19021000f, -0.01910000f, -0.39681500f, 0.78985800f, -0.46761300f,

-0.03633000f, -0.19021000f, -0.05000000f, -0.00944700f, 0.58868700f, -0.80830600f,

0.06910000f, 0.16180000f, -0.09511000f, 0.46746700f, 0.58868900f, -0.65948500f,

0.00000000f, 0.16180000f, -0.11756000f, 0.76582300f, 0.58869100f, -0.25876300f,

0.11180000f, 0.16180000f, -0.03633000f, 0.77165900f, 0.58869400f, 0.24079200f,

0.11180000f, 0.16180000f, 0.03633000f, 0.48275000f, 0.58868900f, 0.64838100f,

0.06910000f, 0.16180000f, 0.09511000f, 0.00944700f, 0.58868700f, 0.80830600f,

0.00000000f, 0.16180000f, 0.11756000f, -0.46746700f, 0.58868900f, 0.65948500f,

-0.06910000f, 0.16180000f, 0.09511000f, -0.76582300f, 0.58869100f, 0.25876300f,

-0.11180000f, 0.16180000f, 0.03633000f, -0.77165900f, 0.58869400f, -0.24079200f,

-0.11180000f, 0.16180000f, -0.03633000f, -0.48275000f, 0.58868900f, -0.64838100f,

-0.06910000f, 0.16180000f, -0.09511000f, -0.00485100f, 0.30967300f, -0.95083100f,

0.09511000f, 0.11756000f, -0.13090000f, 0.55496000f, 0.30967100f, -0.77209000f,

0.00000000f, 0.11756000f, -0.16180000f, 0.90279400f, 0.30967300f, -0.29843700f,

0.15388000f, 0.11756000f, -0.05000000f, 0.90579300f, 0.30966800f, 0.28921300f,

0.15388000f, 0.11756000f, 0.05000000f, 0.56280600f, 0.30966700f, 0.76639200f,

0.09511000f, 0.11756000f, 0.13090000f, 0.00485100f, 0.30967300f, 0.95083100f,

0.00000000f, 0.11756000f, 0.16180000f, -0.55496000f, 0.30967100f, 0.77209000f,

-0.09511000f, 0.11756000f, 0.13090000f, -0.90279400f, 0.30967300f, 0.29843700f,

-0.15388000f, 0.11756000f, 0.05000000f, -0.89694500f, 0.28781700f, -0.33563600f,

-0.15388000f, 0.11756000f, -0.05000000f, -0.50441100f, 0.33900900f, -0.79413000f,

-0.09511000f, 0.11756000f, -0.13090000f, 0.00000000f, 0.00000000f, -1.00000000f,

0.11180000f, 0.06180000f, -0.15388000f, 0.58778600f, -0.00000300f, -0.80901700f,

0.00000000f, 0.06180000f, -0.19021000f, 0.95105600f, -0.00000200f, -0.30901800f,

0.18090000f, 0.06180000f, -0.05878000f, 0.95105600f, 0.00000200f, 0.30901800f,

0.18090000f, 0.06180000f, 0.05878000f, 0.58778600f, 0.00000300f, 0.80901700f,

0.11180000f, 0.06180000f, 0.15388000f, 0.00000000f, 0.00000000f, 1.00000000f,

0.00000000f, 0.06180000f, 0.19021000f, -0.58778600f, -0.00000300f, 0.80901700f,

-0.11180000f, 0.06180000f, 0.15388000f, -0.95105600f, -0.00000200f, 0.30901800f,

-0.18090000f, 0.06180000f, 0.05878000f, -0.96861000f, -0.03159300f, -0.24657000f,

-0.18090000f, 0.06180000f, -0.05878000f, -0.62450500f, 0.02259700f, -0.78069400f,

-0.11180000f, 0.06180000f, -0.15388000f, 0.00485100f, -0.30967300f, -0.95083100f,

0.11756000f, 0.00000000f, -0.16180000f, 0.56280600f, -0.30966700f, -0.76639200f,

0.00000000f, 0.00000000f, -0.20000000f, 0.90579300f, -0.30966800f, -0.28921300f,

0.19021000f, 0.00000000f, -0.06180000f, 0.90279400f, -0.30967300f, 0.29843700f,

0.19021000f, 0.00000000f, 0.06180000f, 0.55496100f, -0.30967100f, 0.77209000f,

0.11756000f, 0.00000000f, 0.16180000f, -0.00485100f, -0.30967300f, 0.95083100f,

0.00000000f, 0.00000000f, 0.20000000f, -0.56280600f, -0.30966700f, 0.76639200f,

-0.11756000f, 0.00000000f, 0.16180000f, -0.90579300f, -0.30966800f, 0.28921300f,

-0.19021000f, 0.00000000f, 0.06180000f, -0.90279400f, -0.30967300f, -0.29843700f,

-0.19021000f, 0.00000000f, -0.06180000f, -0.55496100f, -0.30967100f, -0.77209000f,

-0.11756000f, 0.00000000f, -0.16180000f, 0.00944700f, -0.58868700f, -0.80830600f,

0.11180000f, -0.06180000f, -0.15388000f, 0.48275000f, -0.58868900f, -0.64838100f,

0.00000000f, -0.06180000f, -0.19021000f, 0.77165900f, -0.58869400f, -0.24079200f,

0.18090000f, -0.06180000f, -0.05878000f, 0.74246000f, -0.60631000f, 0.28485300f,

0.18090000f, -0.06180000f, 0.05878000f, 0.43799200f, -0.56183500f, 0.70178600f,

0.11180000f, -0.06180000f, 0.15388000f, -0.00944700f, -0.58868700f, 0.80830600f,

0.00000000f, -0.06180000f, 0.19021000f, -0.48275000f, -0.58868900f, 0.64838100f,

-0.11180000f, -0.06180000f, 0.15388000f, -0.77165900f, -0.58869400f, 0.24079200f,

-0.18090000f, -0.06180000f, 0.05878000f, -0.76582300f, -0.58869100f, -0.25876300f,

-0.18090000f, -0.06180000f, -0.05878000f, -0.46746700f, -0.58868900f, -0.65948500f,

-0.11180000f, -0.06180000f, -0.15388000f, 0.01340000f, -0.80964100f, -0.58677300f,

0.09511000f, -0.11756000f, -0.13090000f, 0.35573600f, -0.80964300f, -0.46683000f,

0.00000000f, -0.11756000f, -0.16180000f, 0.56219400f, -0.80964200f, -0.16857600f,

0.15388000f, -0.11756000f, -0.05000000f, 0.54251800f, -0.82748600f, 0.14471000f,

0.15388000f, -0.11756000f, 0.05000000f, 0.37293400f, -0.79603500f, 0.47670600f,

0.09511000f, -0.11756000f, 0.13090000f, -0.01340000f, -0.80964100f, 0.58677300f,

0.00000000f, -0.11756000f, 0.16180000f, -0.35573600f, -0.80964300f, 0.46683000f,

-0.09511000f, -0.11756000f, 0.13090000f, -0.56219400f, -0.80964200f, 0.16857600f,

-0.15388000f, -0.11756000f, 0.05000000f, -0.55391200f, -0.80964200f, -0.19406500f,

-0.15388000f, -0.11756000f, -0.05000000f, -0.33405400f, -0.80964200f, -0.48258500f,

-0.09511000f, -0.11756000f, -0.13090000f, 0.02972900f, -0.94062300f, -0.33814800f,

0.06910000f, -0.16180000f, -0.09511000f, 0.22281000f, -0.94062300f, -0.25609200f,

0.00000000f, -0.16180000f, -0.11756000f, 0.33078600f, -0.94062300f, -0.07621800f,

0.11180000f, -0.16180000f, -0.03633000f, 0.31241300f, -0.94062300f, 0.13276600f,

0.11180000f, -0.16180000f, 0.03633000f, 0.17470700f, -0.94062300f, 0.29104100f,

0.06910000f, -0.16180000f, 0.09511000f, -0.02972900f, -0.94062300f, 0.33814800f,

0.00000000f, -0.16180000f, 0.11756000f, -0.22281000f, -0.94062300f, 0.25609200f,

-0.06910000f, -0.16180000f, 0.09511000f, -0.33078600f, -0.94062300f, 0.07621800f,

-0.11180000f, -0.16180000f, 0.03633000f, -0.31241300f, -0.94062300f, -0.13276600f,

-0.11180000f, -0.16180000f, -0.03633000f, -0.17470700f, -0.94062300f, -0.29104100f,

-0.06910000f, -0.16180000f, -0.09511000f, 0.00000000f, -1.00000000f, 0.00000000f

};

//【球体モデル】インデックスバッファ:球体を構成する180個の三角形を構成する頂点番号リスト

private static Int16[] _vertexIndices = new Int16[] {

// ■MetasequoiaLE R2.4で球体モデルを作成⇒.x形式で保存⇒Excelで読込・編集

0, 1, 2, 0, 3, 1, 0, 4, 3, 0, 5, 4, 0, 6, 5, 0, 7, 6, 0, 8, 7, 0, 9, 8, 0, 10, 9, 0, 2, 10,

11,12,13, 12,14,13, 14,15,13, 15,16,13, 16,17,13, 17,18,13, 18,19,13, 19,20,13, 20,21,13, 21,11,13,

1,22,23, 1,23,2, 3,24,22, 3,22,1, 4,25,24, 4,24,3, 5,26,25, 5,25,4, 6,27,26, 6,26,5,

7,28,27, 7,27,6, 8,29,28, 8,28,7, 9,30,29, 9,29,8, 10,31,30, 10,30,9, 10,2,23, 10,23,31,

22,32,33, 22,33,23, 24,34,32, 24,32,22, 25,35,34, 25,34,24, 26,36,35, 26,35,25, 27,37,36, 27,36,26,

28,38,37, 28,37,27, 29,39,38, 29,38,28, 30,40,39, 30,39,29, 31,41,40, 31,40,30, 23,33,41, 23,41,31,

32,42,43, 32,43,33, 34,44,42, 34,42,32, 35,45,44, 35,44,34, 36,46,45, 36,45,35, 37,47,46, 37,46,36,

38,48,47, 38,47,37, 39,49,48, 39,48,38, 40,50,49, 40,49,39, 41,51,50, 41,50,40, 33,43,51, 33,51,41,

42,52,53, 42,53,43, 44,54,52, 44,52,42, 45,55,54, 45,54,44, 46,56,55, 46,55,45, 47,57,56, 47,56,46,

48,58,57, 48,57,47, 49,59,58, 49,58,48, 50,60,59, 50,59,49, 50,51,61, 50,61,60, 43,53,61, 43,61,51,

52,62,63, 52,63,53, 54,64,62, 54,62,52, 55,65,64, 55,64,54, 56,66,65, 56,65,55, 57,67,66, 57,66,56,

58,68,67, 58,67,57, 59,69,68, 59,68,58, 60,70,69, 60,69,59, 61,71,70, 61,70,60, 53,63,71, 53,71,61,

62,72,73, 62,73,63, 64,74,72, 64,72,62, 65,75,74, 65,74,64, 66,76,75, 66,75,65, 67,77,76, 67,76,66,

68,78,77, 68,77,67, 69,79,78, 69,78,68, 70,80,79, 70,79,69, 71,81,80, 71,80,70, 63,73,81, 63,81,71,

72,82,83, 72,83,73, 74,84,82, 74,82,72, 75,85,84, 75,84,74, 75,76,86, 75,86,85, 77,87,86, 77,86,76,

78,88,87, 78,87,77, 79,89,88, 79,88,78, 80,90,89, 80,89,79, 81,91,90, 81,90,80, 73,83,91, 73,91,81,

82,12,11, 82,11,83, 84,14,12, 84,12,82, 85,15,14, 85,14,84, 86,16,15, 86,15,85, 87,17,16, 87,16,86,

88,18,17, 88,17,87, 89,19,18, 89,18,88, 90,20,19, 90,19,89, 91,21,20, 91,20,90, 83,11,21, 83,21,91

};

//【カラーインデックスデータ】A/Dコンバータの計測値に対応する球体表示色を与える配列

private static int[] ColorLookupTable = new int[] {

0x00FFFFFF, 0x00FBFBFB, 0x00F7F7F7, 0x00F3F3F3, 0x00EFEFEF, 0x00EBEBEB, 0x00E7E7E7, 0x00E4E4E4, 0x00E0E0E0, 0x00DCDCDC,

0x00D8D8D8, 0x00D4D4D4, 0x00D0D0D0, 0x00CCCCCC, 0x00C8C8C8, 0x00C4C4C4, 0x00C0C0C0, 0x00BCBCBC, 0x00B8B8B8, 0x00B4B4B4,

0x00B1B1B1, 0x00ADADAD, 0x00A9A9A9, 0x00A5A5A5, 0x00A1A1A1, 0x009D9D9D, 0x00999999, 0x00959595, 0x00919191, 0x008D8D8D,

0x00898989, 0x00858585, 0x00828282, 0x007E7E7E, 0x007A7A7A, 0x00767676, 0x00727272, 0x006E6E6E, 0x006A6A6A, 0x00666666,

0x00626262, 0x005E5E5E, 0x005A5A5A, 0x00565656, 0x00525252, 0x004F4F4F, 0x004B4B4B, 0x00474747, 0x00434343, 0x003F3F3F,

0x003B3B3B, 0x000000FF, 0x000005FF, 0x00000AFF, 0x00000FFF, 0x000014FF, 0x000019FF, 0x00001EFF, 0x000023FF, 0x000028FF,

0x00002DFF, 0x000032FF, 0x000037FF, 0x00003CFF, 0x000041FF, 0x000046FF, 0x00004BFF, 0x000050FF, 0x000055FF, 0x00005AFF,

0x00005FFF, 0x000064FF, 0x000069FF, 0x00006EFF, 0x000073FF, 0x000078FF, 0x00007DFF, 0x000082FF, 0x000087FF, 0x00008CFF,

0x000091FF, 0x000096FF, 0x00009BFF, 0x0000A0FF, 0x0000A5FF, 0x0000AAFF, 0x0000AFFF, 0x0000B4FF, 0x0000B9FF, 0x0000BEFF,

0x0000C3FF, 0x0000C8FF, 0x0000CDFF, 0x0000D2FF, 0x0000D7FF, 0x0000DCFF, 0x0000E1FF, 0x0000E6FF, 0x0000EBFF, 0x0000F0FF,

0x0000F5FF, 0x0000FAFF, 0x0000FFFF, 0x0000FFFA, 0x0000FFF5, 0x0000FFF0, 0x0000FFEB, 0x0000FFE6, 0x0000FFE1, 0x0000FFDC,

0x0000FFD7, 0x0000FFD2, 0x0000FFCD, 0x0000FFC8, 0x0000FFC3, 0x0000FFBE, 0x0000FFB9, 0x0000FFB4, 0x0000FFAF, 0x0000FFAA,

0x0000FFA5, 0x0000FFA0, 0x0000FF9B, 0x0000FF96, 0x0000FF91, 0x0000FF8C, 0x0000FF87, 0x0000FF82, 0x0000FF7D, 0x0000FF78,

0x0000FF73, 0x0000FF6E, 0x0000FF69, 0x0000FF64, 0x0000FF5F, 0x0000FF5A, 0x0000FF55, 0x0000FF50, 0x0000FF4B, 0x0000FF46,

0x0000FF41, 0x0000FF3C, 0x0000FF37, 0x0000FF32, 0x0000FF2D, 0x0000FF28, 0x0000FF23, 0x0000FF1E, 0x0000FF19, 0x0000FF14,

0x0000FF0F, 0x0000FF0A, 0x0000FF05, 0x0000FF00, 0x0005FF00, 0x000AFF00, 0x000FFF00, 0x0014FF00, 0x0019FF00, 0x001EFF00,

0x0023FF00, 0x0028FF00, 0x002DFF00, 0x0032FF00, 0x0037FF00, 0x003CFF00, 0x0041FF00, 0x0046FF00, 0x004BFF00, 0x0050FF00,

0x0055FF00, 0x005AFF00, 0x005FFF00, 0x0064FF00, 0x0069FF00, 0x006EFF00, 0x0073FF00, 0x0078FF00, 0x007DFF00, 0x0082FF00,

0x0087FF00, 0x008CFF00, 0x0091FF00, 0x0096FF00, 0x009BFF00, 0x00A0FF00, 0x00A5FF00, 0x00AAFF00, 0x00AFFF00, 0x00B4FF00,

0x00B9FF00, 0x00BEFF00, 0x00C3FF00, 0x00C8FF00, 0x00CDFF00, 0x00D2FF00, 0x00D7FF00, 0x00DCFF00, 0x00E1FF00, 0x00E6FF00,

0x00EBFF00, 0x00F0FF00, 0x00F5FF00, 0x00FAFF00, 0x00FFFF00, 0x00FFFA00, 0x00FFF500, 0x00FFF000, 0x00FFEB00, 0x00FFE600,

0x00FFE100, 0x00FFDC00, 0x00FFD700, 0x00FFD200, 0x00FFCD00, 0x00FFC800, 0x00FFC300, 0x00FFBE00, 0x00FFB900, 0x00FFB400,

0x00FFAF00, 0x00FFAA00, 0x00FFA500, 0x00FFA000, 0x00FF9B00, 0x00FF9600, 0x00FF9100, 0x00FF8C00, 0x00FF8700, 0x00FF8200,

0x00FF7D00, 0x00FF7800, 0x00FF7300, 0x00FF6E00, 0x00FF6900, 0x00FF6400, 0x00FF5F00, 0x00FF5A00, 0x00FF5500, 0x00FF5000,

0x00FF4B00, 0x00FF4600, 0x00FF4100, 0x00FF3C00, 0x00FF3700, 0x00FF3200, 0x00FF2D00, 0x00FF2800, 0x00FF2300, 0x00FF1E00,

0x00FF1900, 0x00FF1400, 0x00FF0F00, 0x00FF0A00, 0x00FF0500, 0x00FF0000

};

//【カラーゲージの頂点データ】【CustomVertex.PositionTextured形式】

private static float[] GaugeVertex = new float[] {

0.0f, 0.0f, 2.0f, 0.0f, 0.0f,

100.0f, 0.0f, 2.0f, 1.0f, 0.0f,

100.0f, 10.0f, 2.0f, 1.0f, 1.0f,

0.0f, 10.0f, 2.0f, 0.0f, 1.0f

};

//【ちびミク表示枠の頂点データ】【CustomVertex.PositionTextured形式】

private static float[] MikuGaugeVertex = new float[] {

25.0f, 25.0f, 0.0f, 0.0f, 0.0f,

-25.0f, 25.0f, 0.0f, 1.0f, 0.0f,

-25.0f, -25.0f, 0.0f, 1.0f, 1.0f,

25.0f, -25.0f, 0.0f, 0.0f, 1.0f

};

//【カラーゲージのインデックスデータ】ちびミクと兼用

private static Int16[] GaugeIndex = new Int16[] {

0, 1, 2, 2, 3, 0

};

private NyARTransMatResult __OnBuffer_nyar_transmat = new NyARTransMatResult(); // NyARToolkitのマーカー検出結果のバッファ

private bool _is_marker_enable; // NyARToolkitのマーカー検出結果フラグ

private Matrix _trans_mat; // NyARToolkitの座標変換マトリックス

private int ADcount = 1; // ADC計測値の上位8ビット

private int LoopNum = 1; //

private const Int16 nSample = 50; // FIFOの段数

private static Matrix[] FIFO_mat = new Matrix[nSample]; // 過去nSample個分のセンサの座標変換マトリックス

private static Int32[] FIFO_color = new Int32[nSample]; // 過去nSample個分のA/D変換値に基づく色情報

private Int16 wp = 0; // FIFO書込み側(A/D変換側)ポインタ

private Int16 rp = 0; // FIFO読出し側(DirectX側)ポインタ

// System.Windows.Forms.Timer timer2 = new System.Windows.Forms.Timer();

System.IO.Ports.SerialPort SerialPort_for_ADC = new System.IO.Ports.SerialPort(); //【ADC用シリアルポート】

private static Byte[] TxBuf = new Byte[256]; //【シリアル通信送信用バッファ】

private static Byte[] RxBuf = new Byte[256]; //【シリアル通信受信用バッファ】未使用

private string RxMsg; //【シリアル通信受信用行バッファ】このプログラムではこちらを使用

//***********************************************************************

// 時間待ち(ミリ秒単位) 【Win32APIをimportする方法】

//***********************************************************************

[DllImport("kernel32.dll")]

public static extern void Sleep(Int32 dwMilliseconds);

// ■■■■■■■■■■ 【非同期カメラ・キャプチャー・イベントハンドラ】 ■■■■■■■■■■

// CaptureDeviceからの1フレーム毎のキャプチャーイベントをハンドリングして、バッファと背景テクスチャを更新する。

// MainLoop処理の進行とは無関係に非同期に行われている。キャプチャー画像とマーカーの位置検出はここで行っている。

public void OnBuffer(CaptureDevice i_sender, double i_sample_time, IntPtr i_buffer, int i_buffer_len)

{

int w = i_sender.video_width; // CaptureDeviceの横方向画素数を取得

int h = i_sender.video_height; // CaptureDeviceの縦方向画素数を取得

int s = w * (i_sender.video_bit_count / 8); // CaptureDeviceの1スキャンライン分のバイト数を取得

NyARTransMatResult nyar_transmat = this.__OnBuffer_nyar_transmat; // 座標変換バッファを用意

//テクスチャにRGBを取り込み()

lock (this)

{

this._raster.setBuffer(i_buffer, i_sender.video_vertical_flip); //カメラ映像をARのバッファにコピー

bool is_marker_enable = this._ar.detectMarkerLite(this._raster, 160); //マーカー検出処理をしきい値110で実施

if (is_marker_enable) // マーカーを発見できたか? Yesなら以下を実施

{

this._ar.getTransmationMatrix(nyar_transmat); // 座標変換マトリックスを計算する

this._utils.toD3dMatrix(nyar_transmat, ref this._trans_mat); // マトリックスをコピーする

}

this._is_marker_enable=is_marker_enable; // 検出可否フラグをコピー

this._surface.CopyFromXRGB32(this._raster); // カメラキャプチャー画像を背景テクスチャーにコピーして更新する

}

return;

}

// ■■■■■■■■■■ 【キャプチャーを開始する関数】 ■■■■■■■■■■

public void StartCap()

{

this._cap.StartCapture();

return;

}

// ■■■■■■■■■■ 【キャプチャーを停止する関数】 ■■■■■■■■■■

public void StopCap()

{

this._cap.StopCapture();

return;

}

// ■■■■■■■■■■ 【Direct3Dデバイスを準備する関数】 ■■■■■■■■■■

private Device PrepareD3dDevice(Control i_window)

{

PresentParameters pp = new PresentParameters();

pp.Windowed = true;

pp.SwapEffect = SwapEffect.Flip;

pp.BackBufferFormat = Format.X8R8G8B8;

pp.BackBufferCount = 1;

pp.EnableAutoDepthStencil = true;

pp.AutoDepthStencilFormat = DepthFormat.D16;

CreateFlags fl_base = CreateFlags.FpuPreserve;

try{

return new Device(0, DeviceType.Hardware, i_window.Handle, fl_base|CreateFlags.HardwareVertexProcessing, pp);

}catch (Exception ex1){

Debug.WriteLine(ex1.ToString());

try{

return new Device(0, DeviceType.Hardware, i_window.Handle, fl_base | CreateFlags.SoftwareVertexProcessing, pp);

}catch (Exception ex2){

// 作成に失敗

Debug.WriteLine(ex2.ToString());

try{

return new Device(0, DeviceType.Reference, i_window.Handle, fl_base | CreateFlags.SoftwareVertexProcessing, pp);

}catch (Exception ex3){

throw ex3;

}

}

}

}

// ■■■■■■■■■■ 【Direct3Dデバイスを準備する関数】 ■■■■■■■■■■

public bool InitializeApplication(Form1 topLevelForm, CaptureDevice i_cap_device)

{

topLevelForm.ClientSize=new Size(SCREEN_WIDTH,SCREEN_HEIGHT);

//キャプチャを作る(QVGAでフレームレートは30)

i_cap_device.SetCaptureListener(this);

i_cap_device.PrepareCapture(SCREEN_WIDTH, SCREEN_HEIGHT, 30);

this._cap = i_cap_device;

//【Augmented Realityの設定】

//ARラスタを作る(DirectShowキャプチャ仕様)。

this._raster = new DsBGRX32Raster(i_cap_device.video_width, i_cap_device.video_height, i_cap_device.video_width * i_cap_device.video_bit_count / 8);

//AR用カメラパラメータファイルをロードして設定する

NyARParam ap = new NyARParam();

ap.loadARParamFromFile(AR_CAMERA_FILE);

ap.changeScreenSize(SCREEN_WIDTH, SCREEN_HEIGHT);

//AR用のパターンコードを読み出し

NyARCode code = new NyARCode(16, 16);

code.loadARPattFromFile(AR_CODE_FILE);

//1パターンのみを追跡するクラスを作成

this._ar = new NyARSingleDetectMarker(ap, code, 40.0, this._raster.getBufferType(), NyARSingleDetectMarker.PF_NYARTOOLKIT);

//Direct3D用のユーティリティ準備

this._utils = new NyARD3dUtil();

//計算モードの設定

this._ar.setContinueMode(true);

//3dデバイスを準備する

this._device = PrepareD3dDevice(topLevelForm);

this._device.RenderState.ZBufferEnable = true; // 陰面処理をzバッファ方式で行う

this._device.RenderState.ZBufferFunction = Compare.LessEqual; //.LessEqual;

this._device.RenderState.Lighting = true; // 光源計算処理を行う true;

// 平行光源(無限遠に設定される方向を持った光源。太陽光の様な光源)

this._device.Lights[0].Type = LightType.Directional;

this._device.Lights[0].Diffuse = Color.White;

this._device.Lights[0].Direction = new Vector3(-0.57735f, -0.57735f, -0.57735f);

this._device.Lights[0].Enabled = true;

// 環境光(全ての物体を均一に照らす光源)

this._device.RenderState.Ambient = Color.FromArgb(0x202020);

//カメラProjectionの設定

Matrix tmp = new Matrix();

this._utils.toCameraFrustumRH(ap, ref tmp);

this._device.Transform.Projection = tmp;

// ビュー変換の設定(左手座標系ビュー行列で設定する)

// 0,0,0から、Z+方向を向いて、上方向がY軸

this._device.Transform.View = Matrix.LookAtLH(

new Vector3(0.0f, 0.0f, 0.0f), new Vector3(0.0f, 0.0f, 1.0f), new Vector3(0.0f, 1.0f, 0.0f));

Viewport vp = new Viewport();

vp.X = 0;

vp.Y = 0;

vp.Height = ap.getScreenSize().h;

vp.Width = ap.getScreenSize().w;

vp.MaxZ = 1.0f;

//ビューポート設定

this._device.Viewport = vp;

// 球体(頂点数92)の準備

this._vertexBuffer = new VertexBuffer(typeof(CustomVertex.PositionNormal),

nVertex, this._device, Usage.None, CustomVertex.PositionNormal.Format, Pool.Managed);

//92点から成る球体の頂点座標情報を格納する

// ■MetasequoiaLE R2.4で適当に球体を作成⇒.x形式で保存⇒Excelで読込・表示倍率、書式を編集。色は取り敢えず『黒』

for (var i = 0; i < nVertex; i++)

{ vertices[i] = new CustomVertex.PositionNormal(

_vertex[6 * i] * Bairitsu, _vertex[6 * i + 1] * Bairitsu, _vertex[6 * i + 2] * Bairitsu,

_vertex[6 * i + 3], _vertex[6 * i + 4], _vertex[6 * i + 5] );

}

// 頂点バッファをロックする

using (GraphicsStream data = this._vertexBuffer.Lock(0, 0, LockFlags.None))

{ data.Write(vertices); // 頂点データを頂点バッファにコピーします

this._vertexBuffer.Unlock(); // 頂点バッファのロックを解除します

}

// インデックスバッファの作成

// 第2引数の数値は(三角ポリゴンの数)*(ひとつの三角ポリゴンの頂点数)*

// (16 ビットのインデックスサイズ(2byte))

this._indexBuffer = new IndexBuffer(this._device, nTriangle * 3 * 2, Usage.WriteOnly, Pool.Managed, true);

// インデックスバッファをロックする

using (GraphicsStream data = this._indexBuffer.Lock(0, 0, LockFlags.None))

{ data.Write(_vertexIndices); // インデックスデータをインデックスバッファにコピーします

this._indexBuffer.Unlock(); // インデックスバッファのロックを解除します

}

//【カラーバー】の準備

this._vertexBufferT = new VertexBuffer(typeof(CustomVertex.PositionTextured),

4, this._device, Usage.None, CustomVertex.PositionTextured.Format, Pool.Managed);

for (var i = 0; i < 4; i++)

{ verticesT[i] = new CustomVertex.PositionTextured(

GaugeVertex[5 * i], GaugeVertex[5 * i + 1], GaugeVertex[5 * i + 2],

GaugeVertex[5 * i + 3], GaugeVertex[5 * i + 4] );

}

// 頂点バッファをロックする

using (GraphicsStream data = this._vertexBufferT.Lock(0, 0, LockFlags.None))

{

data.Write(verticesT); // 頂点データを頂点バッファにコピーします

this._vertexBufferT.Unlock(); // 頂点バッファのロックを解除します

}

// インデックスバッファの作成

// 第2引数の数値は(三角ポリゴンの数)*(ひとつの三角ポリゴンの頂点数)*

// (16 ビットのインデックスサイズ(2byte))

this._indexBufferT = new IndexBuffer(this._device, 2 * 3 * 2, Usage.WriteOnly, Pool.Managed, true);

// インデックスバッファをロックする

using (GraphicsStream data = this._indexBufferT.Lock(0, 0, LockFlags.None))

{

data.Write(GaugeIndex); // インデックスデータをインデックスバッファにコピーします

this._indexBufferT.Unlock(); // インデックスバッファのロックを解除します

}

//【ミクゲージ】の準備

this._vertexBufferM = new VertexBuffer(typeof(CustomVertex.PositionTextured),

4, this._device, Usage.None, CustomVertex.PositionTextured.Format, Pool.Managed);

for (var i = 0; i < 4; i++)

{ verticesM[i] = new CustomVertex.PositionTextured(

MikuGaugeVertex[5 * i], MikuGaugeVertex[5 * i + 1], MikuGaugeVertex[5 * i + 2],

MikuGaugeVertex[5 * i + 3], MikuGaugeVertex[5 * i + 4] );

}

// 頂点バッファをロックする

using (GraphicsStream data = this._vertexBufferM.Lock(0, 0, LockFlags.None))

{

data.Write(verticesM); // 頂点データを頂点バッファにコピーします

this._vertexBufferM.Unlock(); // 頂点バッファのロックを解除します

}

// テクスチャーファイルをDirectXにロードする

this._texture = TextureLoader.FromFile(this._device, TEXTURE_FILE);

this._Mtexture1 = TextureLoader.FromFile(this._device, MTEXTURE_FILE1);

this._Mtexture2 = TextureLoader.FromFile(this._device, MTEXTURE_FILE2);

//背景サーフェイスを作成

this._surface = new NyARSurface_XRGB32(this._device, SCREEN_WIDTH, SCREEN_HEIGHT);

this._is_marker_enable = false;

return true;

}

// ■■■■■■■■■■ 【メインループ処理】 ■■■■■■■■■■

public void MainLoop()

{

//ARの計算

lock (this)

{

//【背景サーフェイスを直接描画】

Surface dest_surface = this._device.GetBackBuffer(0, 0, BackBufferType.Mono);

Rectangle src_dest_rect = new Rectangle(0, 0, SCREEN_WIDTH, SCREEN_HEIGHT);

this._device.StretchRectangle(this._surface.d3d_surface, src_dest_rect, dest_surface, src_dest_rect, TextureFilter.None);

//【A/D変換処理を実行、FIFOに格納する】マーカー検出確度が0.4より大きい場合のみ

if (this._is_marker_enable && this._ar.getConfidence() > 0.4)

{

ADconvert();

if (ADcount != -1)

{

Matrix transform_mat2 = Matrix.Translation(-85.0f, -10.0f, 3.0f); // 球体オブジェクト表示位置のオフセット[単位mm]

transform_mat2 *= this._trans_mat; // 座標変換マトリックスを計算(オフセット考慮)

FIFO_mat[wp] = transform_mat2; // FIFOに座標変換マトリックスを格納

FIFO_color[wp] = ColorLookupTable[ADcount]; // FIFOにA/D変換値を格納

rp = wp; // 読出し開始ポインタ(rp)を設定

wp++; if (wp == nSample) { wp = 0; } // 書込みポインタ(wp)を設定

}

}

//【FIFOにデータが蓄積するまで表示を留保する】

if (LoopNum != nSample) { LoopNum++; return; }

//【3Dオブジェクトの描画初期化】

this._device.BeginScene(); // シーン作成開始

this._device.Clear(ClearFlags.ZBuffer, Color.DarkBlue, 1.0f, 0); // フレームバッファ・クリア

this._device.SetStreamSource(0, this._vertexBuffer, 0); // 頂点バッファをデバイスのデータストリームにバインド

this._device.VertexFormat = CustomVertex.PositionNormal.Format; // 頂点バッファのフォーマットを設定

this._device.Indices = this._indexBuffer; // インデックスバッファを設定

this._device.RenderState.Lighting = true; // 光源計算処理を行う true;

this._device.Lights[0].Enabled = true;

float position = 100.0f * (float)ADcount / 256.0f;

Matrix transform_matG = Matrix.Translation(position - 20.0f, 40.0f, -5.0f); // 球体オブジェクト表示位置のオフセット[単位mm]

transform_matG *= this._trans_mat; // 座標変換マトリックスを計算(オフセット考慮)

//【ゲージの位置にカレント値を球体で表示】

Material material = new Material();

material.Diffuse = Color.FromArgb(FIFO_color[rp]);

material.Ambient = Color.FromArgb(FIFO_color[rp]);

material.Specular = Color.White; // FromArgb(FIFO_color[rp]);

material.SpecularSharpness = 10.0f;

material.Emissive = Color.FromArgb(FIFO_color[rp]);

this._device.Material = material;

// 頂点バッファをロックする

using (GraphicsStream data = this._vertexBuffer.Lock(0, 0, LockFlags.None))

{

data.Write(vertices); // 頂点データを頂点バッファにコピーします

this._vertexBuffer.Unlock(); // 頂点バッファのロックを解除します

}

this._device.SetTransform(TransformType.World, transform_matG); // 計算したマトリックスで座標変換

this._device.RenderState.CullMode = Cull.Clockwise; // 頂点登録順時計回りで座標から法線ベクトルを演算し、裏ポリゴン非表示を決定

this._device.DrawIndexedPrimitives(PrimitiveType.TriangleList, 0, 0, nVertex, 0, nTriangle); // 3Dレンダリング(描画処理)

//【FIFOに蓄積した測定結果(球体)を表示する】

for (int j = 0; j < nSample; j++)

{

// 頂点データを設定する

//Material material = new Material();

material.Diffuse = Color.FromArgb(FIFO_color[rp]);

material.Ambient = Color.FromArgb(FIFO_color[rp]);

material.Specular = Color.White; // FromArgb(FIFO_color[rp]);

material.SpecularSharpness = 10.0f;

material.Emissive = Color.FromArgb(FIFO_color[rp]);

this._device.Material = material;

// 頂点バッファをロックする

using (GraphicsStream data = this._vertexBuffer.Lock(0, 0, LockFlags.None))

{

data.Write(vertices); // 頂点データを頂点バッファにコピーします

this._vertexBuffer.Unlock(); // 頂点バッファのロックを解除します

}

this._device.SetTransform(TransformType.World, FIFO_mat[rp]); // 計算したマトリックスで座標変換

this._device.RenderState.CullMode = Cull.Clockwise; // 頂点登録順時計回りで座標から法線ベクトルを演算し、裏ポリゴン非表示を決定

this._device.DrawIndexedPrimitives(PrimitiveType.TriangleList, 0, 0, nVertex, 0, nTriangle); // 3Dレンダリング(描画処理)

rp--; if (rp <0 ) { rp = nSample-1; }

}

this._device.Lights[0].Enabled = false;

this._device.RenderState.Lighting = false; // 光源計算処理を行う true;

this._device.SetStreamSource(0, this._vertexBufferT, 0); // 頂点バッファをデバイスのデータストリームにバインド

this._device.VertexFormat = CustomVertex.PositionTextured.Format; // 頂点バッファのフォーマットを設定

this._device.Indices = this._indexBufferT; // インデックスバッファを設定

using (GraphicsStream data = this._vertexBufferT.Lock(0, 0, LockFlags.None))

{

data.Write(verticesT); // 頂点データを頂点バッファにコピーします

this._vertexBufferT.Unlock(); // 頂点バッファのロックを解除します

}

this._device.SetTexture(0, this._texture);

this._device.TextureState[0].ConstantColorValue = 0xaa00bb;

this._device.TextureState[0].ColorOperation = TextureOperation.MultiplyAdd; //.Modulate;

this._device.TextureState[0].ColorArgument0 = TextureArgument.Temp;

this._device.TextureState[0].ColorArgument1 = TextureArgument.TextureColor;

this._device.TextureState[0].ColorArgument2 = TextureArgument.Current;

this._device.TextureState[0].AlphaOperation = TextureOperation.Disable;

Matrix transform_mat3 = Matrix.Translation(-20.0f, 25.0f, 0.0f); // 球体オブジェクト表示位置のオフセット[単位mm]

transform_mat3 *= this._trans_mat; // 座標変換マトリックスを計算(オフセット考慮)

this._device.SetTransform(TransformType.World, transform_mat3); // 計算したマトリックスで座標変換

this._device.RenderState.CullMode = Cull.Clockwise; // 頂点登録順時計回りで座標から法線ベクトルを演算し、裏ポリゴン非表示を決定

this._device.DrawIndexedPrimitives(PrimitiveType.TriangleList, 0, 0, 4, 0, 2); // 3Dレンダリング(描画処理)

this._device.SetStreamSource(0, this._vertexBufferM, 0); // 頂点バッファをデバイスのデータストリームにバインド

this._device.VertexFormat = CustomVertex.PositionTextured.Format; // 頂点バッファのフォーマットを設定

this._device.Indices = this._indexBufferT; // インデックスバッファを設定

using (GraphicsStream data = this._vertexBufferM.Lock(0, 0, LockFlags.None))

{ data.Write(verticesM); // 頂点データを頂点バッファにコピーします

this._vertexBufferM.Unlock(); // 頂点バッファのロックを解除します

}

if (ADcount > 200) { this._device.SetTexture(0, this._Mtexture2); } // 計測値に応じてちびミク画像を変更する

else { this._device.SetTexture(0, this._Mtexture1); } //

this._device.SetTransform(TransformType.World, this._trans_mat); // 計算したマトリックスで座標変換

this._device.RenderState.CullMode = Cull.Clockwise; // 頂点登録順時計回りで座標から法線ベクトルを演算し、裏ポリゴン非表示を決定

this._device.DrawIndexedPrimitives(PrimitiveType.TriangleList, 0, 0, 4, 0, 2); // 3Dレンダリング(描画処理)

//【描画はここまで】

this._device.SetTexture(0, null); //【テクスチャー設定をクリア】

this._device.EndScene(); //【シーン作成終了】

this._device.Present(); //【ディスプレイに反映】(ダブルバッファ切替等)

}

return;

}

// ■■■■■■■■■■ 【リソースの破棄をする処理】 ■■■■■■■■■■

public void Dispose()

{

lock (this)

{

if (this._vertexBuffer != null) { this._vertexBuffer.Dispose(); } // 頂点バッファを解放

if (this._indexBuffer != null) { this._indexBuffer.Dispose(); } // インデックスバッファを解放

if (this._texture != null) { this._texture.Dispose(); } // テクスチャー領域を開放

if (this._Mtexture1 != null) { this._Mtexture1.Dispose(); } // テクスチャー領域を開放

if (this._Mtexture2 != null) { this._Mtexture2.Dispose(); } // テクスチャー領域を開放

if (this._surface != null) { this._surface.Dispose(); } // 背景テクスチャー領域を解放

if (this._device != null) { this._device.Dispose(); } // Direct3D デバイスのリソース解放

}

}

// ■■■■■■■■■■ 【A/Dコンバータの初期化処理】 ■■■■■■■■■■

public Boolean ADCInitialize()

{

//【ADC用シリアルポートの設定】

this.SerialPort_for_ADC.PortName = COMPORT;

// this.SerialPort_for_ADC.BaudRate = 115200; //【通常のシリアル通信の場合の設定】

// this.SerialPort_for_ADC.DataBits = 8; //

// this.SerialPort_for_ADC.StopBits = System.IO.Ports.StopBits.One; //

// this.SerialPort_for_ADC.Parity = System.IO.Ports.Parity.None; //

// this.SerialPort_for_ADC.ReadTimeout = 50; //

// this.SerialPort_for_ADC.ReadBufferSize = 256; //

// this.SerialPort_for_ADC.WriteBufferSize = 256; //

try { this.SerialPort_for_ADC.Open(); }

catch (Exception) { MessageBox.Show("シリアルポートが開けません"); return false; }

TxBuf[0] = 0x45; // "E" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[1] = 0x0D; // CR

TxBuf[2] = 0x0A; // LF

this.SerialPort_for_ADC.Write(TxBuf, 0, 3);

Sleep(50);

RxMsg = this.SerialPort_for_ADC.ReadLine();

//【モードレジスタ】000A 【コマンド】C08000A + CR + LF

TxBuf[0] = 0x43; // "C" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[1] = 0x30; // "0" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[2] = 0x38; // "8" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[3] = 0x30; // "0" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[4] = 0x30; // "0" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[5] = 0x30; // "0" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[6] = 0x41; // "A" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[7] = 0x0D; // CR

TxBuf[8] = 0x0A; // LF

this.SerialPort_for_ADC.Write(TxBuf, 0, 9);

Sleep(50);

RxMsg = this.SerialPort_for_ADC.ReadLine();

//【コンフィギュレーションレジスタ】5080 【コマンド】C105080 + CR + LF

TxBuf[0] = 0x43; // "C" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[1] = 0x31; // "1" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[2] = 0x30; // "0" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[3] = 0x35; // "5" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[4] = 0x30; // "0" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[5] = 0x38; // "8" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[6] = 0x30; // "0" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[7] = 0x0D; // CR

TxBuf[8] = 0x0A; // LF

this.SerialPort_for_ADC.Write(TxBuf, 0, 9);

Sleep(50);

RxMsg = this.SerialPort_for_ADC.ReadLine();

//【IOレジスタ】0A 【コマンド】C280A + CR + LF

TxBuf[0] = 0x43; // "C" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[1] = 0x32; // "2" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[2] = 0x38; // "8" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[3] = 0x30; // "0" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[4] = 0x41; // "A" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[5] = 0x0D; // CR

TxBuf[6] = 0x0A; // LF

this.SerialPort_for_ADC.Write(TxBuf, 0, 7);

Sleep(50);

RxMsg = this.SerialPort_for_ADC.ReadLine();

//【オフセットレジスタ】800000 【コマンド】C30800000 + CR + LF

TxBuf[0] = 0x43; // "C" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[1] = 0x33; // "3" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[2] = 0x30; // "0" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[3] = 0x38; // "8" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[4] = 0x30; // "0" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[5] = 0x30; // "0" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[6] = 0x30; // "0" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[7] = 0x30; // "0" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[8] = 0x30; // "0" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[9] = 0x0D; // CR

TxBuf[10] = 0x0A; // LF

this.SerialPort_for_ADC.Write(TxBuf, 0, 11);

Sleep(50);

RxMsg = this.SerialPort_for_ADC.ReadLine();

return true;

}

// ■■■■■■■■■■ 【A/Dコンバータの終了処理】 ■■■■■■■■■■

public void ADCTerminate()

{

TxBuf[0] = 0x43; // "C" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[1] = 0x30; // "0" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[2] = 0x38; // "8" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[3] = 0x36; // "6" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[4] = 0x30; // "0" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[5] = 0x30; // "0" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[6] = 0x41; // "A" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[7] = 0x0D; // CR

TxBuf[8] = 0x0A; // LF

this.SerialPort_for_ADC.Write(TxBuf, 0, 9);

Sleep(5);

RxMsg = this.SerialPort_for_ADC.ReadLine();

this.SerialPort_for_ADC.Close();

}

// ■■■■■■■■■■ 【A/D変換処理】 ■■■■■■■■■■

// ここにA/D変換読み取り処理を挿入する。設定範囲を0≦ADcount≦255とする。

public void ADconvert()

{

string c;

this.SerialPort_for_ADC.DiscardInBuffer();

Sleep(10);

TxBuf[0] = 0x52; // "R" A:41 B:42 C:43 D:44 E:45 F:46

TxBuf[1] = 0x0D; // CR

TxBuf[2] = 0x0A; // LF

this.SerialPort_for_ADC.Write(TxBuf, 0, 3);

Sleep(10);

RxMsg = this.SerialPort_for_ADC.ReadLine(); //【1サンプル受信】

c = RxMsg.Substring(1, 1);

if (String.IsNullOrEmpty(c))

{

c = RxMsg.Substring(2, 1);

ADcount = ConvertAscii(c);

c = RxMsg.Substring(3, 1);

ADcount = ADcount*16 + ConvertAscii(c);

}

else

{

ADcount = ConvertAscii(c); //【先頭2文字を8ビットの数値に変換】

c = RxMsg.Substring(2, 1);

ADcount = ADcount * 16 + ConvertAscii(c);

}

}

public int ConvertAscii(string c)

{

int a=-1;

switch (c)

{

case "0":

a = 0; break;

case "1":

a = 1; break;

case "2":

a = 2; break;

case "3":

a = 3; break;

case "4":

a = 4; break;

case "5":

a = 5; break;

case "6":

a = 6; break;

case "7":

a = 7; break;

case "8":

a = 8; break;

case "9":

a = 9; break;

case "A":

a = 10; break;

case "B":

a = 11; break;

case "C":

a = 12; break;

case "D":

a = 13; break;

case "E":

a = 14; break;

case "F":

a = 15; break;

}

return (a);

}

}

}

|

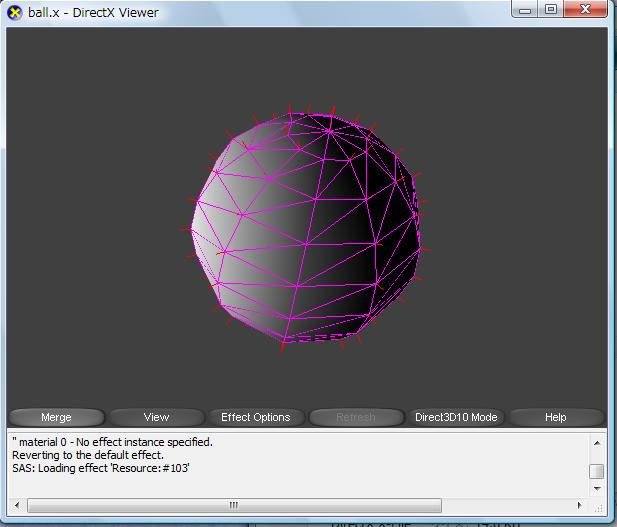

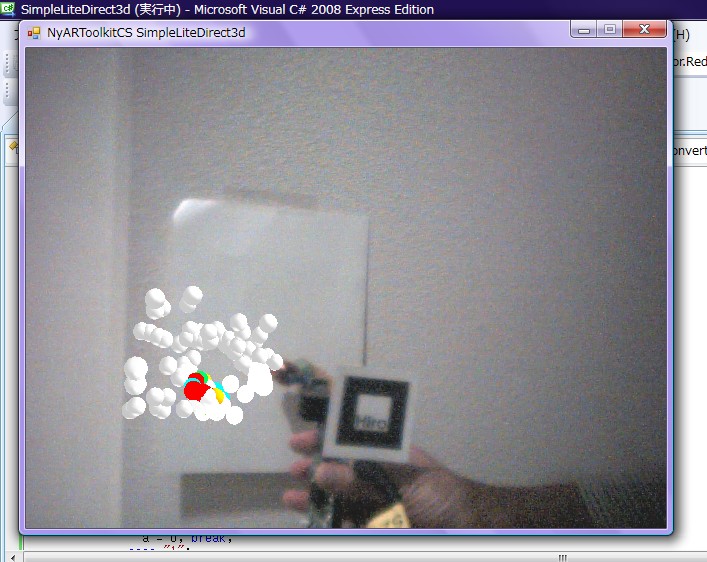

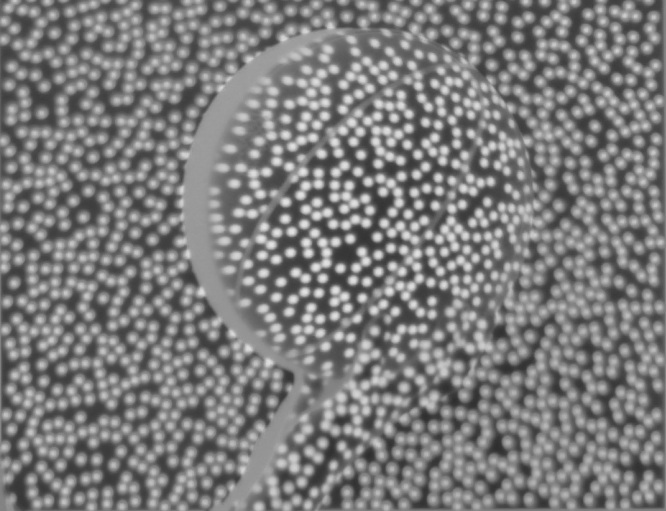

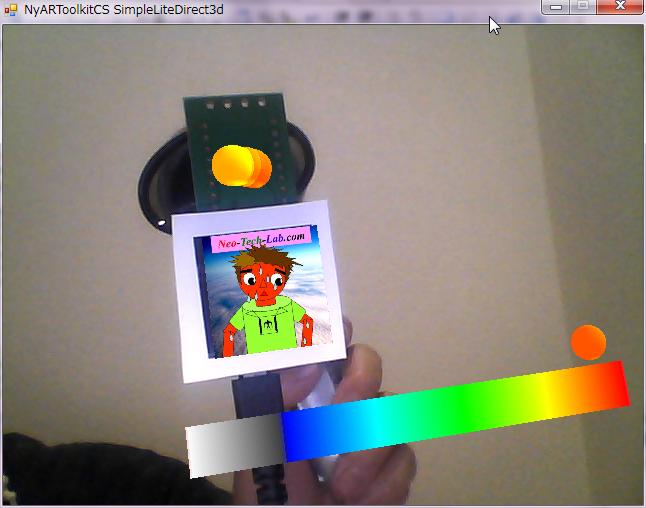

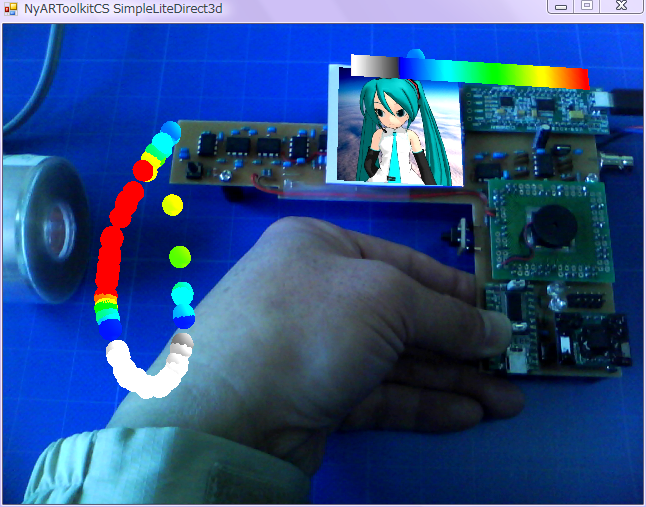

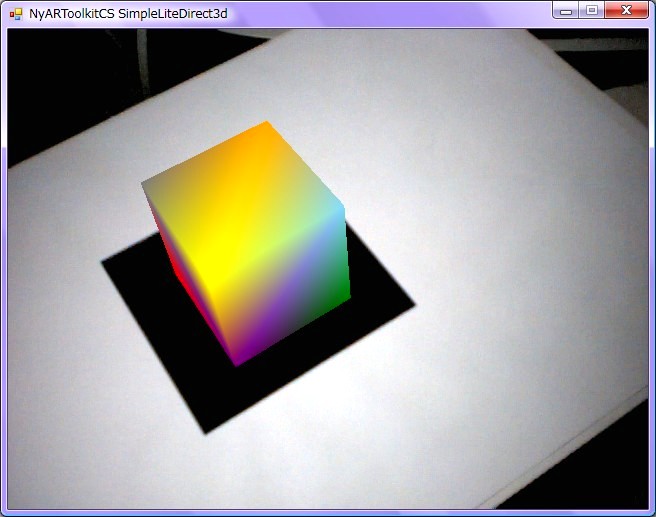

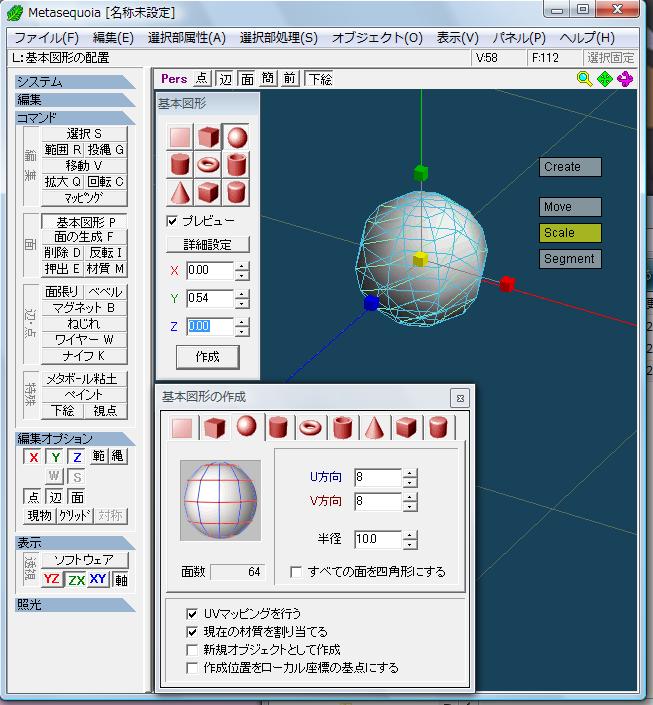

【参照図1】MetasequoiaLE R.24の表示画面の例

【参照図1】MetasequoiaLE R.24の表示画面の例